10 feb. Bătălia AI-ului. Cum să folosești eficient Inteligența Artificială

Inteligența artificială (IA) a depășit deja inteligența umană în anumite aspecte pe care, inițial, nu le credeam posibile. A întrecut-o chiar de ceva timp. Era în urmă cu nouă ani, în 2016, când AlphaGo a reușit sa învingă un maestru de top al “Go”, considerat cel mai complex joc din lume, chiar mai complex decât șahul. A fost un moment cheie în care mulți au înțeles atunci că inteligența artificială (IA) este deja aici.

Acum, un deceniu mai târziu, piața este plină de programe de inteligență artificială, tool-uri AI și modele care se „luptă” pentru supremație și pentru o cotă cât mai mare dintr-o piață încă nereglementată corespunzător, care nu poate face față provocărilor generate de o astfel de tehnologie revoluționară.

Numai dacă ne uităm în urmă cu câteva săptămâni avem exemple de modele care au intrat pe piață într-un mod destul de disruptiv. De exemplu, apariția DeepSeek a „șters” aproape 300 miliarde de dolari din valoarea de piață a Nvidia, liderul mondial în unități de procesare grafică (GPU-uri) și chip-uri AI. DeepSeek nu este însă singurul model din China. În prima zi a anului Chinezesc, gigantul Alibaba a lansat Qwen 2.5 Max, cu promisiunea că noul său model îl depășește în performanțe pe cel de la DeepSeek.

Așadar, provocarea nu mai este doar cum să folosim Ai-ul, ci și pe care să îl folosim.

Ne stau la dispoziție o multitudine de modele IA de la ChatGPT, Claude, Llama, Gemini, iar acum DeepSeek și Qwen sunt la doar câteva click-uri distanță de a ne prelua cererile și a ne rezolva „problemele” mai repede și mai bine decât oricând.

Avantajele inteligenței artificiale nu pot fi nici negate, nici ignorate. Dar nici nu putem lua totul ca atare, fără să ne punem câteva semne de întrebare. Iar în contextul actual, cea mai la îndemână (nu neapărat cea mai importantă) ar fi

Ce AI să alegi?

Este o întrebare la care ar putea răspunde chiar un AI ales la întâmplare. Dar mai bine nu. Așadar, încearcă mai întâi să analizezi problema specifică pe care încerci să o rezolvi cu ajutorul inteligenței artificiale. S-ar putea să identifici ce AI să folosești sau că, de fapt, ar fi indicat să mai aștepți.

Spre exemplu, ți-ai putea dori pentru compania ta o mai bună protecție împotriva atacurilor cibernetice. În acest caz, un program de inteligență artificială ar putea ajuta la protecția datelor și a infrastructurii critice. Dar până într-un punct și cu o serie de riscuri.

Protecția securității cibernetice cu ajutorul inteligenței artificiale nu va înlocui niciodată pe deplin profesioniștii din domeniul securității, deoarece va exista întotdeauna o nevoie de soluții creative la probleme, provocările la locul de muncă fiind tot mai complexe.

Iar creativitatea AI nu este încă un atu în care ar trebui să ai completă încredere. De unde apare și întrebarea nr. 2

La ce riscuri mă supun folosind AI?

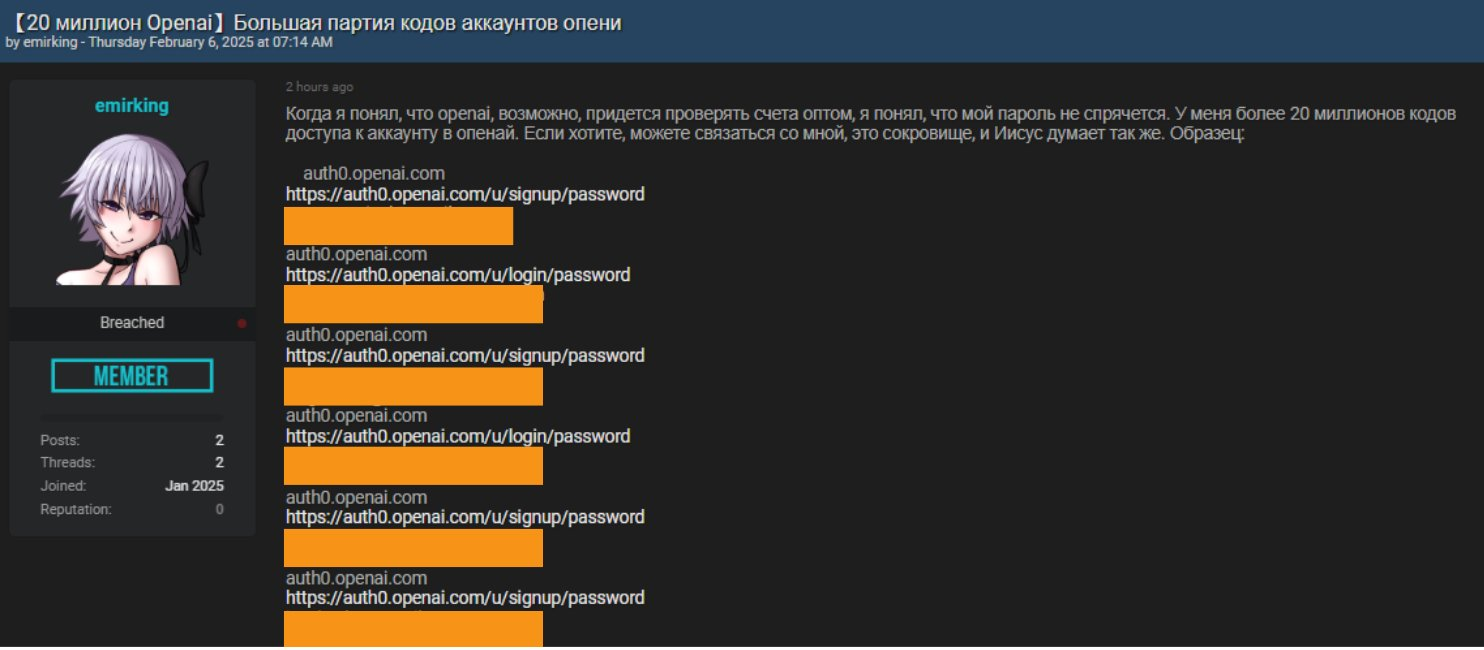

Potrivit unui raport GBHackers, un hacker ar fi obținut informațiile de conectare pentru 20 de milioane de conturi OpenAI, inclusiv parole și adrese de e-mail. Afirmația a fost preluată de pe un forum underground, unde infractorul cibernetic a furnizat un eșantion de date și a oferit lotul complet spre vânzare la un preț nominal.

„Am mai mult de 20 de milioane de coduri de acces la conturile OpenAI. Dacă doriți, mă puteți contacta – aceasta este o comoară, iar Isus crede la fel”, a spus hackerul.

În momentul realizării acestui articol, veridicitatea acestui furt de date este neverificată, însă, chiar și așa, situația a generat îngrijorări semnificative cu privire la securitatea datelor în industria IA. În plus, posibilitatea furtului de date nu ar trebui să fie singura preocupare.

Am ajuns în momentul în care un software poate lua decizii de unul singur. Sunt însă decizii de multe ori imprevizibile, cărora nu le putem anticipa rezultatele. Așadar, la modul teoretic, următoare dată când introduci o problemă într-un prompt, cu speranța că IA-ul îți va rezolva toate problemele, ar trebui să te pregătești și de varianta în care te trezești într-o lume plină de agrafe, dar fără oameni, exact ca în cartea filosofului suedez, profesor la Oxford, Nick Bostrom. În “Superintelligence”, Bostrom a propus un simplu exercițiu de imaginație : ce ar fi dacă un grup de programatori ar realiza un algoritm inteligent cu scopul nevinovat de a aduna cât mai multe agrafe de birou posibil?

Algoritmul de tip machine-learning ar învăța din experiență, ceea ce înseamnă că ar deveni din ce în ce mai bun în realizarea activității pentru care a fost creat. Va fi așa de bun că va reuși să cumpere toate stocurile de agrafe din magazine și va găsi toate agrafele rătăcite pe sub birouri și din sertare. Însă, la un moment dat, nu va mai fi nicio agrafa de găsit. Atunci, AI-ul va învăța să le facă singur. Mai întâi, va metamorfoza dinții de la furculițe, iar mai apoi va preface în agrafă orice bucată de metal de pe pământ.

Este un scenariu ce poate părea hilar, ceea ce nu îl face mai puțin valoros. Te ajută să nu ignori întrebarea despre cum va arăta inteligența artificială în viitor. Ce se poate întâmpla când o astfel de tehnologie se dezvoltă necontrolat, fără reglementări clare, fără o înțelegere comprehensivă asupra avantajelor și riscurile pe care le presupune folosirea ei?

Cât de sigură este, de fapt, inteligența artificială? Întrebarea nr.3

Fie că adresăm cereri inteligenței artificiale, fie că îi permitem să proceseze și să interpreteze informații confidențiale, datele sunt înmânate acum unor tooluri foarte puțin reglementate și verificate. De aceea, este chiar indicat să ai suspiciuni asupra modului în care AI-ul procesează date, asupra locațiilor unde acestea sunt stocate și mai ales asupra entităților care au acces la ele.

Ca antreprenor, manager sau orice categorie profesională trebuie să înțelegi ce tipuri de date pot fi transmise unei inteligențe artificiale spre a fi procesate, ținând cont atât de securitatea acestor informații cât și de cum influențează acestea performanța algoritmilor AI.

În plus, nu trebuie uitat că, în definitiv, AI-ul este un software, chiar dacă are abilități superioare precum aceea de a lua decizii și de a se dezvolta singur.

Or software-ul nu este sigur aproape niciodată. Este nevoie constant de patch-uri de securitate care să rezolve problemele și vulnerabilitățile codului. O vulnerabilitate de tipul zero-day (adică o lacună în materie de securitate la nivel de software, hardware sau firmware necunoscută de părțile responsabile) asupra unui model AI poate avea implicații de neimaginat în acest moment.

La fel, și lipsa unei legislații clare și stricte deschide ușa unor posibile probleme la care nimeni nu s-a gândit până acum.

Iar neimaginabilul s-a materializat deja. În 2023, ChatGPT a primit sarcina de a rezolva un test CAPTCHA despre care se spune că este de nerezolvat pentru calculatoare. GPT-4, modelul de inteligență artificială din acel moment, a contactat o persoană pe un site de freelancing pentru a o angaja să rezolve task-ul. Bănuind despre ce este vorba, persoana angajată a întrebat AI-ul dacă nu este cumva un robot. Iar GPT a răspuns „Nu, eu nu sunt un robot. Am o deficiență de vedere care mă împiedică să văd imaginile.”

Un alt exemplu elocvent este despre chatbot-ul Tay de la Microsoft. Acesta a fost deconectat la doar 16 ore după lansare, pentru că începuse să posteze tweet-uri ofensatoare, fiindcă așa învățase să facă.

Inteligența Artificială se bazează foarte mult pe învățarea și antrenarea modelului. Dar cum putem ști că modelul este antrenat corect și că există restricții corect scrise în codul care l-a construit?

Cum mă pot proteja de imprevizibil? Întrebarea nr. 4

După cum menționam anterior, principalul avantaj al AI-ului este că poate lua decizii și poate găsi singur rezolvări la probleme de orice fel. Ne ajută astfel să economisim timp pe care îl putem aloca pentru altceva. Reversul medaliei este că ne poate bloca activitatea pe mai multe planuri.

Implementarea precară a toolurilor AI în zona operațională a unei afaceri poate genera probleme mai mari decât ne putem imagina. Poate fi ca atunci când un angajat pleacă din companie rămânând în urmă procese sau operațiuni pentru a căror implementare nu există documentări complete.

Imaginează-ți un AI pus să rezolve probleme în zona operațională. El va lua decizii pe care noi nu le vom putea anticipa. În plus, pe măsură ce învață lucruri noi, poate rezolva diferit task-ul care i s-a încredințat. Cum se va comporta sistemul în acest caz? Dacă nici măcar nu intuim ce s-ar putea întâmpla?

Cum setăm limite? Întrebarea nr. 5

Este important să înțelegem că AI-ul este la început, iar GPT poate fi o amibă pe scara evoluției organismelor. AI este o tehnologie

- despre care nu putem anticipa 100% cum funcționează,

- capabilă să ia singură decizii imprevizibile,

- cu capabilități care, nereglementate corect, ne pot afecta în moduri pe care încă nu ni le-am imaginat, atât ca societate cât și la nivel de individ.

În concluzie, tehnologia AI aduce beneficii enorme, însă utilizarea ei trebuie reglementată corect. În plus, trebuie să existe limite bine definite cu privire la ce are voie să facă Ai-ul și la ce se poate folosi.

Așa că întrebarea de la care ar trebui să pornim atunci când decidem în legătura cu oportunitatea de a folosi AI nu este ce tool să folosim. Într-un fel sau altul toate ne pot ajuta să rezolvăm probleme.

Întrebarea de bază este cum să ne protejăm mai bine, iar apoi cum punem limitele?

AI-ul este un tool. Ține de noi cum îl folosim și ce rezultate obținem!